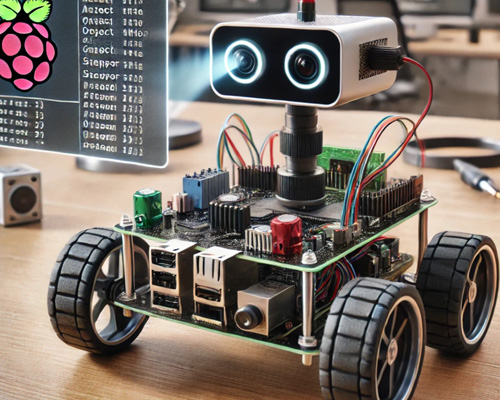

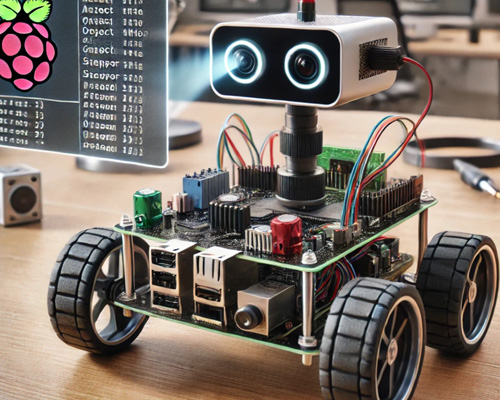

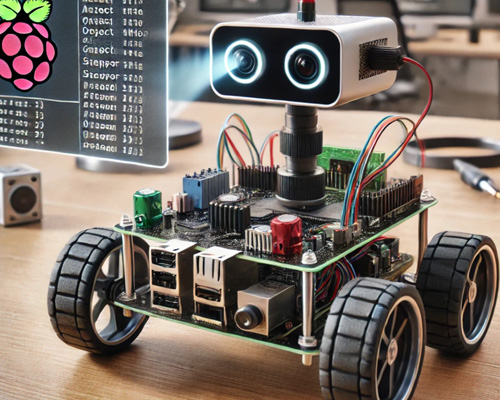

KI-gesteuertes Objekt

Eine autonome Robotikplattform mit Echtzeit-Computer-Vision und Deep-Learning-Fähigkeiten zur intelligenten Objekterkennung und -interaktion.

Eine autonome Robotikplattform mit Echtzeit-Computer-Vision und Deep-Learning-Fähigkeiten zur intelligenten Objekterkennung und -interaktion.

Mehrachsiges Kameraarray mit Tiefensensor und Infrarotfunktionen

NVIDIA Jetson Nano mit optimierten neuronalen Netz-Inferenz-Pipelines

6-Achs-Servosystem mit PID-Reglern für präzise Roboterbewegungen

Webbasiertes Steuerungspanel mit Live-Videoübertragung und Telemetrie-Dashboard

YOLOv5-basierte Erkennung mit 30 FPS identifiziert mehr als 15 Objektklassen mit Bounding-Box-Visualisierung.

A*- und RRT-Algorithmen für autonome Navigation um Hindernisse mit dynamischer Neuplanung.

Greifersteuerung mit Kraftrückkopplungssensoren für sichere und präzise Pick-and-Place-Vorgänge.

Geräteinternes Transfer-Learning ermöglicht dem Roboter, neue Objekte mit minimalen Trainingsproben zu erkennen.

Stereoskopisches Sehen kombiniert mit Tiefensensoren für präzise 3D-Raumkartierung der Umgebung.

Latenzarmes WebRTC-Streaming für Fernsteuerung mit Tastatur-, Gamepad- oder mobiler Eingabe.

3D-gedrucktes Fahrgestell und Komponentenhalterung, entwickelt in FreeCAD mit Spannungsanalyse-Simulation.

Kamerakalibrierung, Bildvorverarbeitung und YOLOv5-Modelltraining mit einem benutzerdefinierten Datensatz von 5.000 Bildern.

Servomotorintegration mit inverser Kinematik für flüssige 6-DOF-Arm- und Lokomotionsbewegungen.

ROS2-Framework verbindet Vision-, Planungs- und Steuerungsknoten mit Echtzeit-Nachrichtenübermittlung.

Iteratives Testen in kontrollierten Umgebungen mit zunehmend komplexen Navigations- und Erkennungsszenarien.

Von autonomer Navigation bis Computer Vision entwickelt unser Team maßgeschneiderte Robotiklösungen, die die Grenzen intelligenter Automatisierung verschieben.